Japan

サイト内の現在位置を表示しています。

AIと人権

ガバナンス

AIと人権に関する推進体制

NECは、AIの社会実装や生体情報をはじめとするデータの利活用(以下、AIの利活用)において、Principles(行動原則)にも掲げる「人権の尊重」を最優先に 、「NECグループ人権方針」に沿って事業活動を推進するための指針として、「NECグループ AIと人権に関するポリシー」(以下、全社ポリシー)を策定しています。

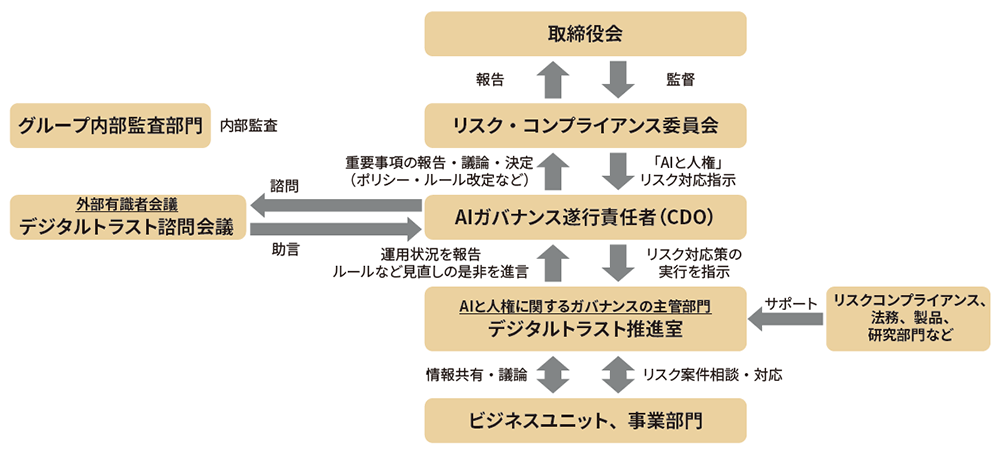

当社は全社ポリシーに基づく取り組みをコーポレート・ガバナンスに組み込んでおり、取締役会が監督するリスク・コンプライアンス委員会の指示のもと、AIガバナンス遂行責任者(CDO(チーフデジタルオフィサー))とCDO Office デジタルトラスト推進室を中心としたガバナンス体制を構築しています。

デジタルトラスト推進室はAIと人権に関するガバナンスの主管部門として、AIの利活用に関連した事業活動が人権を尊重したものとなるよう、役員および従業員が遵守すべき基本的事項を定めた社内制度の運用を担っています。

さらに、外部有識者で構成するデジタルトラスト諮問会議を設置し、AIなどの新技術と人権に関連するテーマなどを諮問する体制としています。

戦略

AIと人権に関する戦略

この全社ポリシーに基づき、NECはAIの利活用に関する事業を推進する際、各国・地域の関連法令などの遵守をはじめ、従業員一人ひとりが、企業活動のすべての段階において人権の尊重を常に最優先するものとして念頭に置き、それを⾏動に結びつけていきます。

そこでNECは、全社ポリシーに基づき、主に以下の3点に取り組んでいます。

- AIの利活用が、NECグループだけでなくお客さまやパートナーにおいても適正な用途で⾏われること

- 人権尊重を最優先としたAIの利活用促進に向けた技術開発と人材の育成を⾏うこと

- AIの利活用に関して、さまざまなステークホルダーとの連携・協働を促進すること

なお、NECは、全社ポリシーに基づく「人権尊重を最優先にしたAI提供と利活用(AIと人権)」をESG視点の経営優先テーマ「マテリアリティ」の一つに特定しているほか、顕著な人権課題の一つとして位置づけています。

リスク管理

リスク軽減の取り組み

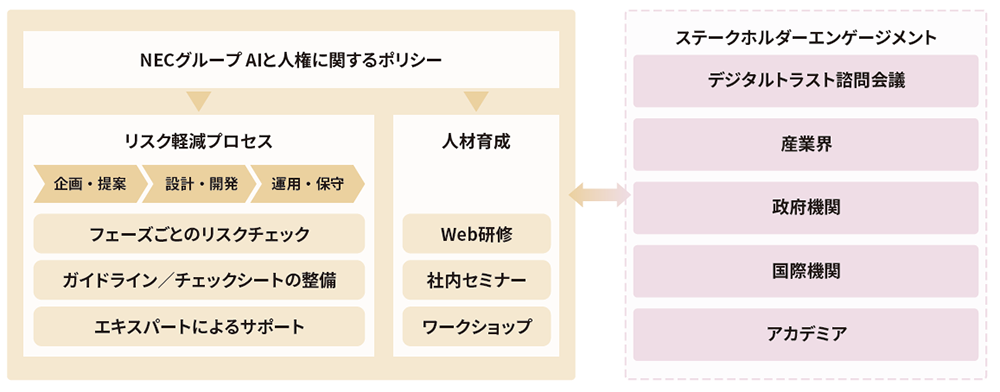

NECは、AIの社会実装や生体情報をはじめとするデータの利活用が、人々の生活を豊かにする反面、その使い方によっては、あるいは意図しない使われ方をされた場合に、プライバシー侵害や差別をはじめとした人権課題を生み出す恐れがあることも理解しています。またAIの利活用の拡大により、事業拡大が見込まれる一方で、プライバシー侵害等を引き起こした場合にはNECのレピュテーション毀損や売上減少につながる可能性もあります。そこで、ポリシーに沿って、事業遂行にあたってリスクの見極めと対策を行う「リスク軽減プロセス」、従業員のリテラシー向上を行う「人材育成」、社外の多様な意見を活動に取り入れる「ステークホルダーエンゲージメント」などに取り組んでいます。

NECはこれらの取り組みを国内外の法規制やガイドラインに基づいて実施しています。特に、経済産業省が2021年7月に公表した「AI原則実践のためのガバナンス・ガイドライン」や、その後継として総務省と経済産業省が2024年4月に公表した「AI事業者ガイドライン」で示されているアジャイル・ガバナンスの考え方に基づき、外部環境の変化に応じて社内ルールと運用の見直しを柔軟に行っています。具体的には、日本、米国、欧州などのAIに関する法規制やガイドラインの動向、AIの利用に関する生活者の受容性などを把握することで、リスクチェックと対策の見直しを行っています。

リスク軽減プロセス

NECでは、AI・生体認証技術によって生じる人権リスクやAI・生体認証技術を利活用するうえで配慮すべき人権リスクを特定し、ガバナンス体制や遵守すべき基本的事項を定めた全社規程、対応事項や運用フローを定めたガイドラインやマニュアル、リスクチェックシートを整備しています。また、企画から運用の各フェーズにおいて、デジタルトラスト推進室と関連部門とが連携してAIの利活用による人権リスクの深刻度に応じた対策を講じています。リスク対応のためのドキュメントや運用プロセスについては、生成AIや生体認証の利活用シーンの拡大、国内外における法規制の変化などに合わせて見直しを継続的に行っています。加えて、リスク軽減の取り組みによって得られた実践的なノウハウや知見をお客さまやパートナーに提供し、社会全体でAIの適切な利活用を促進するため、リスク軽減プロセス構築のためのコンサルティングやAI利用の目的を公表する際に活用するデザインサンプルの提供やお客さまやパートナーへの勉強会の開催などに取り組んでいます。

人材育成

AIと人権に関する業務を定義し、必要なスキルや習熟度を明確化しています。

そして、全社ポリシーに基づき、事業活動において人権を尊重した適切な行動がとれるよう、当社および国内外の関係会社の役員、従業員を対象に以下の研修を実施しています。

Web研修

当社の従業員(臨時従業員および派遣を含む)向けに、AI技術やAI倫理の重要性、関連法規制の動向、AIの利活用に伴う人権・プライバシー配慮事項、全社ポリシーや運用など基礎的な内容を学ぶWeb研修を毎年1回実施(2024年度修了率:97%)

社内セミナー

- AI事業を推進する事業関係者に対して、外部有識者を講師として招き、社会的批判を受けた事例やケーススタディを交えながら、サービス提供時における留意点や対応を具体的に学ぶ社内セミナーを実施

- 経営層に対して、AIと人権に関する国際動向の理解を深め、人権に配慮した事業判断を行えるよう、外部有識者によるセミナーを2021年度から実施

Web研修や社内セミナーに関する資料や動画は社内サイトに公開しており、いつでも内容を確認して理解を深められるようにしています。

ステークホルダーエンゲージメント

法規制や社会受容性などの社会動向に対応するため、さまざまなステークホルダーとの連携、協働に取り組んでいます。

NECデジタルトラスト諮問会議(外部有識者会議)

AIの利活用に伴う新たな課題への対応を強化するため、AIと人権に関するガバナンスの遂行責任者が、法制度や人権、プライバシー、倫理に関する専門的な知見を有する外部有識者(議員)に、NECグループにおける取り組みを諮問するデジタルトラスト諮問会議を開催しています。会議は2019年から毎年2回開催しており、議員との対話をとおして取り組みの高度化と改善を図っています。

2024年7月の会議では、グローバルでのAI・生体認証ビジネスにおける人権リスクの低減の在り方とメッセージ訴求のポイントについて諮問しました。議員の方からは以下のような意見が寄せられました。

- 各国・地域特有の人権リスクを把握するためには、データ・AI関連の法律だけではなく、その国の法制度や文化全体を理解することが必要であり、具体的には憲法と法制度の関係、憲法的な価値観に関係する文化を把握することが特に重要

- リスク対応では、本社が現地法人のガバナンスに積極的に関与し、万が一インシデントが発生した際は、迅速かつ適切に情報収集や対応ができる仕組みを整備することが重要

- 社会価値創造型企業を目指す当社のメッセージ訴求では、社会価値や社会課題の解決が重視される日本と個人の価値が重視される欧米のように、国や地域ごとの価値観の違いを考慮したうえで適切なサービス提供やコミュニケーションを図ることが重要

2025年3月の会議では、AIエージェントの導入に伴い生じる可能性のある人権リスクと必要な対応ついて諮問しました。議員の方からは以下のような意見が寄せられました。

- AIへの過剰な信頼が人間の責任感や道徳性を低下させる可能性がある。人間がAIの出力に対する責任を吸い取るだけの形骸化された存在になる可能性もあることから、人間とAIエージェントとの関係性を適切に設計することが重要

- AIに与える目標設定が妥当であっても、目標達成に向けAIが選択する最適な手段が結果として人権侵害につながる可能性があることに留意が必要

- 複数のAIエージェントが協力して動く場合、問題が生じた際にその責任がどこにあるのか明確化しておくことが重要

2024年度の会議を通じて得られた意見をふまえ、AI・生体認証ビジネスを展開するにあたり各国・地域の特性に配慮した人権リスクの軽減やメッセージ訴求に取り組むとともに、AIエージェントのようなAIの新たな利活用によって生じる可能性のあるリスクへの対応を進め、人権尊重を最優先としたAIの利活用の促進に取り組んでいきます。

国内外の多様なステークホルダーとの連携

AIと人権・プライバシーに関する知見の共有

慶應義塾大学グローバルリサーチインスティテュート(KGRI)と当社は、2018年から共同で研究に取り組み、各国・地域の憲法や憲法文化をもとに、それぞれのデータ保護法制の背景にある基本的な考え方や政治プロセスを調査・分析してきました。2024年度には、これらの研究成果を社会全体で広く共有するため、書籍化に協力するとともに、シンポジウムを共同で開催しました。また、2024年7月からは、AI時代における「尊厳」の価値を考究し、その成果を世界に発信することを目的に設立された慶應義塾大学X Dignityセンターに、サポーター企業として参画しており、今後も共同研究を進めていきます。

AI事業者ガイドライン策定・更新への参加

総務省の「AIネットワーク社会推進会議」およびその関連会合である「AIガバナンス検討会」に構成員として参加し、総務省と経済産業省が2024年4月に公開した「AI事業者ガイドライン」の策定とその後の更新(1.01版:2024年11月、1.1版:2025年3月)に貢献しました。

業界団体での知見共有と課題解決に向けた貢献

一般社団法人データ社会推進協議会や一般社団法人AIガバナンス協会などの業界団体の活動へ参画し、AIのリスクやガバナンスの課題について、企業間における知見の共有や課題解決に向けた議論に参加するとともに、AIに関連する政策や制度の在り方についての政策提言に協力しています。

苦情処理メカニズム

NECの製品、システム、サービスについてお客さまからの相談を受け付けるための国内総合窓口として、「NECカスタマーコミュニケーションセンター」(CCC)を設けています。

指標および目標

中長期目標/重点活動と進捗/成果/課題

中長期目標/重点活動

(対象:特に記載のない場合は日本電気(株)、期間:2021年4月〜2026年3月)

M:マテリアリティに関わる主な非財務目標を示しています。

M: AIの社会実装における、人権を尊重した事業活動の推進

2024年度の目標と進捗/成果/課題と2025年度の目標

2024年度の目標

-

国内外の法規制の動向をふまえたAIガバナンスの継続強化

-

さまざまなステークホルダーとの対話の継続

-

技術の進展に伴う新たなリスクへの対応強化

進捗/成果/課題

-

国内外の法規制の動向をふまえたAIガバナンスの継続強化

- 日本、米国、欧州の法規制やガイドラインの動向を分析し、社内関係者への共有と運用への反映

- Web研修や社内セミナーで最新の法規制の動向を解説

-

さまざまなステークホルダーとの対話の継続

- NECデジタルトラスト諮問会議の開催を通じた有識者からの知見獲得と取り組みへの反映

- 国内外の法規制やガイドライン策定検討のプロセスで、当社の知見やノウハウを活かした意見発信や提言を実施

- お客さまや社外ステークホルダーに対して取り組みを紹介

-

技術の進展に伴う新たなリスクへの対応強化

- AIエージェントによる人権リスクへの対応検討

- 生成AIや生体認証の利活用シーンの拡大に合わせたリスク対応のためのドキュメントの改訂・拡充、ならびに運用プロセスの見直し

2025年度の目標

-

国内外の法規制の動向をふまえたガバナンスの継続強化

-

さまざまなステークホルダーとの対話の継続

-

技術の進展に伴う新たなリスクへの対応強化

NECグループ人権方針

NECグループ人権方針 NEC、「AI事業者ガイドライン」に賛同

NEC、「AI事業者ガイドライン」に賛同