Japan

サイト内の現在位置を表示しています。

業務の効率化・高度化と説明可能性を両立する「AI 不正・リスク検知サービス」

Digital FinanceAIの社会的な影響力の拡大に伴い、AIの判断結果に対して「公平性」「透明性」「説明責任」を確保することの重要性が増しています。NECは、独自の説明可能なAI「異種混合学習」を活用することで、これら3つの観点への対応を実現しています。本稿では、説明可能なAIを効果的に活用した例として、金融機関の不正リスクに対する審査業務を支援するサービス「AI 不正・リスク検知サービス」の概要及びその要素技術を紹介します。

1. はじめに

昨今、新型コロナウイルス感染症(COVID-19)に関連する新たな金融犯罪リスクが懸念されていますが、NECは、金融機関における不正リスクへの対策として、金融機関が安全・安心に金融商品を取り扱えるようAIなどの先進技術を駆使したRiskTech*のサービスを提供しています。また、金融機関における不正リスク対策の業務においては、AIの判断根拠を示せること、つまりはAIの説明可能性が必須要件となるため、AIの説明可能性を本サービスの重要要素ととらえ、検証・開発を進めています。

本稿では、説明可能なAIに関する動向、及び、NECの取り組み事例とそれを支える技術について紹介します。

- *Risk(リスク)とTechnology(技術)を組み合わせた造語。複雑化する金融リスク対応を目的としAIなどの先進技術を活用して、お客様が抱えるリスクを可視 化・最適化し、事前の対処を図るソリューション。

2. 説明可能なAIの動向

本章では、説明可能なAIに関する国内、海外それぞれの動向を紹介します。

2.1 国内動向

AI技術の進展や利用可能なデータの拡大に伴い、AIが、医療や金融などのクリティカルな場面において意思決定支援として活用されるなど、AIの社会的な影響力が急速に拡大しています1)。このような背景から、総務省は「AI利活用ガイドライン」2)(2019)のなかで、AIを利用するうえで留意すべき事項を「AI利活用原則」として公表し、AIの利用者やサービス提供者に対して、本内容を適切に認識し、対応について自主的に検討することを求めています。また、AI利活用原則で示されている重要な観点に「公平性」「透明性」「アカウンタビリティ」が含まれており、AIの判断結果に対する根拠が明確であることや、それをステークホルダーに説明することの必要性が示されています。

これらを踏まえると、AIの説明可能性は、AIサービスの利用者、提供者の双方にとって、今後更に重要性が増していくと考えられます。

2.2 海外動向

国際的にも、AIの説明可能性に関する議論が活発になされています。例えば、G7、国際連合教育科学文化機関(ユネスコ)、経済協力開発機構(OECD)などの会合において、AIの透明性や説明責任に関する事項が、重要なテーマとして議論されています3)。また、欧州や米国などの各国においても、AIの説明可能性に関して、国内と同様の課題認識のもと、AIの活用を促進するうえでの重要テーマとして取り上げられています。更に、その検討内容がAIの活用方針を取りまとめた当局からのガイドラインやレポートなどで公表されています。

3. 説明可能なAIを活用した不正・リスク検知サービス

前述のような背景から、NECは、説明可能なAIを用いて、AIの公平性、透明性、説明責任の実現に資するサービスの研究開発に取り組んでいます。その具体的な活用事例として、本章では、NECがRiskTechのサービスとして提供している「AI 不正・リスク検知サービス」を紹介します。

3.1 サービス概要

金融機関は、アンチ・マネー・ローンダリング(AML)や振り込め詐欺、インターネットバンキングを使用した不正送金、株の不正取引などの金融サービスを利用したさまざまな不正リスクに対する厳格な審査を求められています。NECは、これらの金融機関における不正リスクの審査業務(不正審査業務)をAIにより効率化・高度化するサービス「AI 不正・リスク検知サービス」を提供しており、複数の金融機関の実業務でご利用いただいています。

3.2 「AI 不正・リスク検知サービス」が解決する業務課題

金融機関での不正審査業務では、一般的には、不正の疑いがある顧客や取引の検知に、専用のパッケージシステムや独自に構築した機能などを活用し、システム的に不正候補を抽出しています。これらの不正検知のシステムは、多くの場合、一定の条件を基にアラートを抽出するルールベースでの検知手法を用いています。例えば、AMLの代表的な業務の1つである取引モニタリングのシステムでは、「出金金額がN円以上」「入金回数がN回以上」といったような過去の不正事例等に基づいてさまざまなルールを設定し、マネー・ローンダリングの疑いがある取引を抽出しています。しかし、このようなルールベースによる検知では、検知漏れを発生させないようなルール設定とした場合、大量の不要なアラートすなわちFalse Positiveが発生します。このFalse Positiveに対する審査員の作業負荷が、金融機関にとって大きな課題となっています。

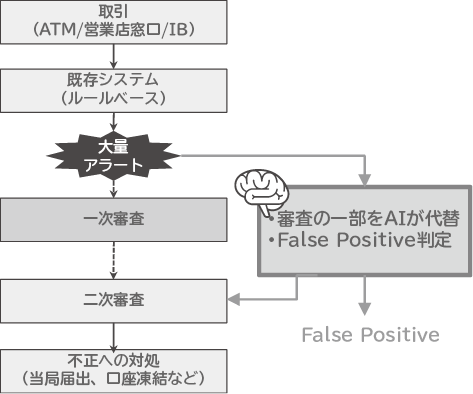

本サービスでは、前述した従来システムにおける課題をAIによって解決します。具体的には、過去の審査員の判定結果を学習したAIモデルにより、過去のFalse Positiveと同様の傾向を持つアラートを自動的にFalse Positiveと判定します。これにより、人手で確認すべきアラートを削減し、審査業務の高度化・効率化を実現しています。例えば、図1のように、二段階で審査を実施する運用を例とした場合、一次審査のすべてまたは大部分をAIが代替し、AIが判断しきれないアラートのみを二次審査として人手で確認するような運用が考えられます。

3.3 不正審査業務で重要となる説明可能性の実現

金融機関の不正審査業務では、判定の正確さに加え、判定結果を説明できることが非常に重要になります。例えば、AMLの取引モニタリング業務では、金融機関は、マネー・ローンダリングの疑いがある取引を当局へ報告する義務があります。その際、なぜその取引を疑わしいと判断したのかなど、届出理由を報告する必要があります。そのため、AIの判断根拠が明確であること、つまり「説明可能性」が業務上の必須要件となります。本サービスは、説明可能性に優れたNEC独自のホワイトボックス型AIである「異種混合学習」を活用することで、高い判定精度を維持したうえで、説明可能性を実現しています。

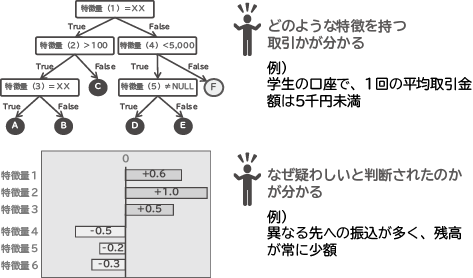

「異種混合学習」では、図2に示すようにAIが疑わしいと判断した取引が「どのような特徴を持つ取引か」「なぜ疑わしいと判断されたか」などを判断するための情報を可視化します。審査員は、これらの情報を基に調査や届出理由の報告が可能となり、実業務に適した形で効果的にAIを活用することができます。

4. 説明可能なAIを実現する技術

本章では、第3章3節の「異種混合学習」を含め、AIの説明可能性を実現する技術について紹介します。

4.1 AIの説明可能性を実現する手法

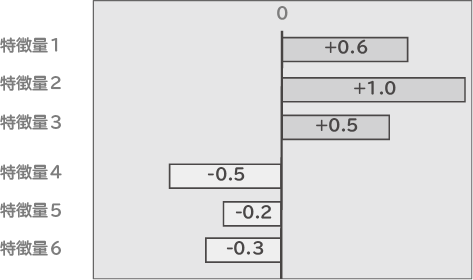

AIの説明可能性を実現する1つの方法として、AIの判断結果に使用した特徴量や、その特徴量がどの程度判断結果に影響を与えたかを可視化することが挙げられます。特徴量の可視化イメージを図3に示します。

このような特徴量の可視化は、ロジスティック回帰などの単純な機械学習のアルゴリズムで実現可能です。また、ディープラーニングなどの複雑なAIアルゴリズムにおいても、AIが使用した特徴量を可視化するための技術が開発されています。一例として、Local Interpretable Model-agnostic Explanations(LIME)、SHapley Additive exPlanations(SHAP)が挙げられます。これらの手法では、説明対象とするデータ点周辺における局所的な近似モデルを考えることで、任意のAIモデルに対して、各特徴量の影響度を可視化できます。なお、LIMEやSHAPを活用する場合は、AIモデルの判定結果に対して、追加的に分析を実施する必要があるため、実運用に当たってはこの点を考慮したシステム設計が必要になります。

4.2 「異種混合学習」の特徴

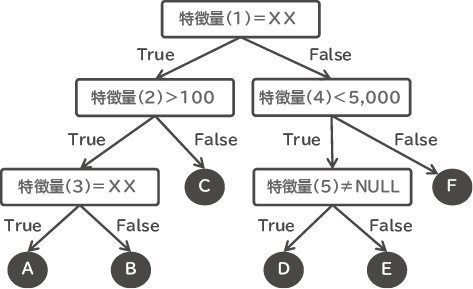

「異種混合学習」は、多種多様なデータに混在するデータ同士の関連性から、特定の規則性で自動的にデータを場合分けし、分析するデータに応じて参照する規則を切り替えます。これにより、高精度な予測を可能としています4)。「異種混合学習」の場合分けのイメージを図4に示します。

また、「異種混合学習」は説明可能性に優れたAIです。前述のLIMEやSHAPは、AIモデル生成後に特定の入力データに対して局所的に説明可能性を与える手法でした。一方、「異種混合学習」は、AIモデルが生成された時点で説明可能性の機能を持っています。具体的には、AIモデルの判定に影響を与えた特徴量の可視化に加え、前述の場合分けの規則性を可視化するための機能が、一つひとつのAIモデルに最初から備わっています。これにより、一般的なAIアルゴリズムと比較して、より多くの情報を簡単に提供でき、AIの説明可能性を高めることができます。

5. むすび

これまで、説明可能なAIに焦点を当てて、その事例や技術を紹介しました。AIシステムは、従来のITシステムと開発手法や運用が異なるため、その活用に当たっては、「公平性」「透明性」「アカウンタビリティ」などが重要である点は、前述の通りです。これらの事項は、AIガバナンス(AIを安全・安心に活用するためのAI特有のガバナンス)として各国で検討がなされており、日本においても、総務省の「AI利活用ガイドライン」(2019)などで、その検討結果が公表されています。

NECは、今回紹介した「異種混合学習」以外に、独自の秘密計算技術やAIモデルを解析して元データを推測するような新手の攻撃からAIモデルを保護する技術など、AIガバナンスを実現するためのさまざまな研究開発を進めています。今後、AIガバナンスへの取り組みを更に強化し、RiskTechサービスを継続的に発展させることで、安全・安心な社会の実現に貢献していきます。

参考文献

執筆者プロフィール

デジタルインテグレーション本部 兼

デジタルビジネス基盤本部 兼

金融システム本部

マネージャー

内閣府:人間中心のAI 社会原則,2019.3

内閣府:人間中心のAI 社会原則,2019.3 総務省:AI利活用ガイドライン 〜AI利活用のためのプラクティカルリファレンス〜,2019.8

総務省:AI利活用ガイドライン 〜AI利活用のためのプラクティカルリファレンス〜,2019.8